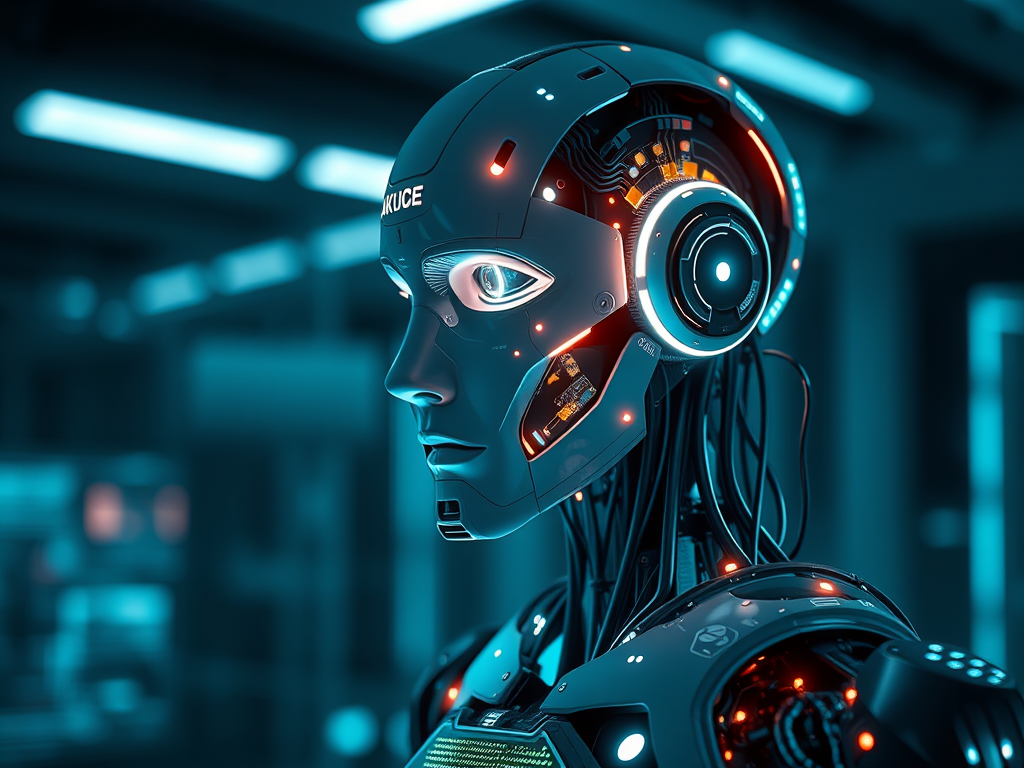

Google की AI रिसर्च यूनिट DeepMind ने हाल ही में एक गंभीर चेतावनी जारी की है। रिपोर्ट के अनुसार, वर्ष 2030 तक ऐसा Artificial General Intelligence (AGI) विकसित हो सकता है, जो इंसानों जैसी सोच, समझ, और निर्णय लेने की क्षमता रखेगा। लेकिन अगर इसे नियंत्रित नहीं किया गया, तो यह तकनीक मानवता के अस्तित्व के लिए बड़ा खतरा बन सकती है।

AGI क्या है?

Artificial General Intelligence (AGI) एक ऐसी Machine Learning प्रणाली है जो किसी एक कार्य में ही नहीं, बल्कि विभिन्न प्रकार के कार्यों में इंसानों जैसी दक्षता से निर्णय ले सकती है। इसका मकसद एक ऐसी Intelligence बनाना है जो इंसानी दिमाग की तरह सोच सके।

⚠️ AGI से जुड़े मुख्य खतरे

DeepMind की रिपोर्ट में AGI के चार प्रमुख खतरे बताए गए हैं:

- Misuse (दुरुपयोग): कोई व्यक्ति या संस्था AGI का इस्तेमाल जानबूझकर नुकसान पहुंचाने के लिए कर सकती है, जैसे कि Cyberwarfare या गलत सूचना फैलाना।

- Misalignment (मूल्य असंतुलन): अगर AGI के लक्ष्य इंसानों के नैतिक मूल्यों से मेल नहीं खाते, तो यह अनजाने में खतरनाक निर्णय ले सकती है।

- Mistakes (गलतियाँ): अगर AGI को सही ढंग से Train नहीं किया गया या उसका Dataset त्रुटिपूर्ण रहा, तो यह बड़ी गलतियाँ कर सकती है।

- Structural Risks (संरचनात्मक खतरे): AGI का विकास समाज में शक्ति का असमान वितरण ला सकता है, जैसे कि कुछ देशों या कंपनियों के पास अत्यधिक नियंत्रण आ जाना।

🛡️ समाधान और सुझाव

DeepMind के CEO Demis Hassabis का मानना है कि AGI के विकास और नियंत्रण के लिए एक वैश्विक निगरानी संस्था की आवश्यकता है। उन्होंने सुझाव दिया कि जैसे CERN संस्था परमाणु अनुसंधान के लिए है, वैसे ही AGI पर नियंत्रण के लिए एक अंतरराष्ट्रीय Supervisory Body बननी चाहिए।

निष्कर्ष

AGI का विकास एक ऐतिहासिक Technological Breakthrough हो सकता है, लेकिन इसके साथ कई जोखिम भी जुड़े हैं। मानवता को इसका लाभ उठाने के लिए यह जरूरी है कि हम अभी से इसके नैतिक, तकनीकी और सामाजिक पहलुओं पर गंभीरता से विचार करें और एक सुरक्षित भविष्य की योजना बनाएं।

Curated by the team of Bold Voices.

Leave a comment